حقائق وأرقام تكشف الجانب المظلم للذكاء الاصطناعي

كتب: أيمن عبد الله – حقائق وأرقام تكشف الجانب المظلم للذكاء الاصطناعي

يُعد الذكاء الاصطناعي (AI) القوة الدافعة للثورة الصناعية الرابعة، حيث تغلغل في كل جانب من جوانب حياتنا اليومية، من المساعدات الصوتية في هواتفنا إلى الخوارزميات المعقدة التي تدير أسواق المال العالمية وتشخص الأمراض المستعصية.

لقد وعدنا هذا التطور التقني بمستقبل أكثر كفاءة ورفاهية، حيث تتولى الآلات المهام الشاقة والروتينية، مما يفسح المجال للبشر للتركيز على الإبداع والابتكار. ومع ذلك، فإن هذا البريق التكنولوجي يخفي تحته طبقات من التعقيدات والمخاطر التي بدأت تطفو على السطح مؤخراً، مثيرةً قلق الخبراء وصناع القرار على حد سواء.

وبينما تتسابق الشركات التكنولوجية الكبرى للهيمنة على هذا السوق الناشئ، تتزايد الأصوات المحذرة من التبعات غير المحسوبة للنشر المتسرع لهذه الأنظمة دون ضوابط أخلاقية وقانونية صارمة.

إن الانبهار بالقدرات التوليدية للنماذج اللغوية الكبيرة قد غطى لفترة وجيزة على الأسئلة الجوهرية حول الخصوصية، والتحيز، والمسؤولية القانونية. لم يعد الحديث عن مخاطر الذكاء الاصطناعي مجرد سيناريوهات خيال علمي تتحدث عن سيطرة الروبوتات، بل تحول إلى قضايا واقعية ملموسة تمس أرزاق الناس، وسلامة معلوماتهم، وحتى استقرار ديمقراطياتهم.

إن الانتقال من مرحلة التفاؤل المفرط إلى مرحلة الواقعية النقدية يتطلب منا النظر بتمعن في البيانات والإحصائيات الصادرة عن مراكز الأبحاث المرموقة والمنظمات الدولية.

هذه الدراسات لا تهدف إلى شيطنة التكنولوجيا، بل إلى تسليط الضوء على “النقاط العمياء” التي قد تؤدي إلى كوارث مجتمعية واقتصادية إذا تم تجاهلها. فمن استهلاك الطاقة المهول الذي يهدد أهداف المناخ، إلى التحيز الخوارزمي الذي يعمق الفجوات الاجتماعية، تتشعب المخاطر لتشكل شبكة معقدة تتطلب تفكيكاً دقيقاً.

وفي سياق عامي 2024 و2025، نقف اليوم عند منعطف تاريخي حرج، حيث تسبق سرعة الابتكار قدرتنا على التنظيم والتشريع بمراحل ضوئية. هذا المقال الموسع لا يكتفي بالسرد النظري، بل يقوم بتشريح الجانب المظلم للذكاء الاصطناعي استناداً إلى أحدث الأرقام الموثقة.

سنستعرض بالأدلة الدامغة كيف يمكن لهذه التكنولوجيا أن تكون سيفاً ذو حدين، وكيف أن التكلفة البشرية والبيئية لتطويرها قد تكون باهظة جداً إذا لم يتم تدارك الأمر بسياسات حكيمة ومسؤولة تضع كرامة الإنسان واستدامة الكوكب فوق اعتبارات الربح السريع.

أولاً: التكلفة البيئية الخفية.. “عطش” الخوارزميات

بينما يُروج للذكاء الاصطناعي كأداة لمكافحة التغير المناخي، تشير البيانات إلى أنه مساهم رئيسي في استنزاف الموارد:

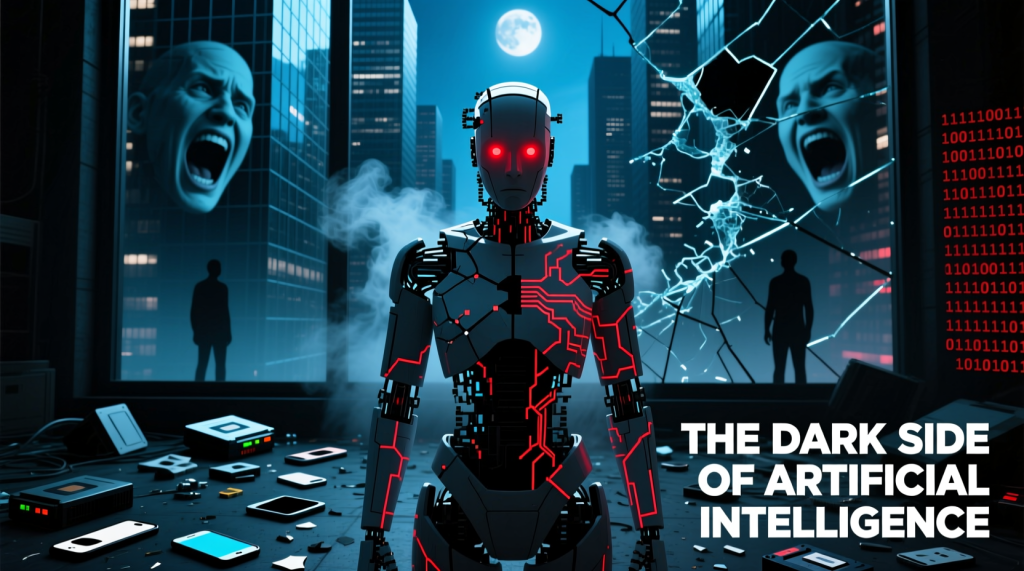

استهلاك المياه: كشفت دراسات بيئية حديثة أن تدريب نموذج واحد مثل (GPT-3) يستهلك حوالي 700,000 لتر من المياه العذبة للتبريد، وهو ما يعادل استهلاك مئات المنازل. الأخطر من ذلك، تشير التقديرات إلى أن كل محادثة قصيرة مع روبوت دردشة (تتراوح بين 10 إلى 50 سؤالاً) تستهلك حوالي 500 مل من الماء. وتتوقع الأبحاث أن يرتفع استهلاك مراكز البيانات للمياه إلى ما بين 4.2 و6.6 مليار متر مكعب بحلول عام 2027.

البصمة الكربونية: أشار تقرير بيئي لعام 2024 إلى أن انبعاثات شركة “Google” ارتفعت بنسبة تقارب 50% في عام 2023 مقارنة بعام 2019، وعزت الشركة ذلك بشكل أساسي إلى الطلب المتزايد على طاقة الحوسبة للذكاء الاصطناعي.

شراهة الطاقة: تستهلك أنظمة الذكاء الاصطناعي التوليدي طاقة تفوق البرمجيات التقليدية بـ 33 مرة لإنجاز المهام نفسها، مما يضع ضغطاً هائلاً على شبكات الكهرباء العالمية.

ثانياً: التسريح الوظيفي.. أرقام تدق ناقوس الخطر

لم يعد استبدال الوظائف مجرد تهديد مستقبلي، بل أصبح واقعاً رصدته الإحصائيات الاقتصادية لعامي 2024 و2025:

حجم التأثير: تشير تقارير “غولدمان ساكس” وغيرها من المؤسسات المالية إلى أن الذكاء الاصطناعي قد يعرض ما يقرب من 300 مليون وظيفة بدوام كامل للخطر عالمياً بحلول عام 2030، وهو ما يمثل حوالي 9.1% من القوى العاملة العالمية.

القطاعات المتضررة: في القطاع المالي، من المتوقع أن يؤثر الذكاء الاصطناعي على 30% من الوظائف، خاصة في مجال التداول الخوارزمي وخدمة العملاء. كما يواجه قطاع التصنيع خطر إزاحة 20 مليون وظيفة بحلول عام 2030 بسبب الأتمتة المتقدمة.

نوايا أصحاب العمل: كشفت استطلاعات حديثة أن 41% من أصحاب العمل حول العالم يخططون لتقليص قوتهم العاملة نتيجة تبني تقنيات الذكاء الاصطناعي خلال السنوات الخمس المقبلة، مما يهدد الاستقرار الوظيفي لملايين العائلات.

ثالثاً: التزييف العميق وتآكل الحقيقة

لعل الجانب الأكثر رعباً هو قدرة الذكاء الاصطناعي على تزييف الواقع بدقة متناهية، مما يخلق أزمات أمنية ومجتمعية:

النمو الانفجاري: شهد عام 2024 زيادة مخيفة في حوادث التزييف العميق (Deepfakes) بنسبة 257% مقارنة بالعام السابق. وفي الربع الأول من عام 2025 وحده، تم تسجيل 179 حادثة كبرى، وهو رقم يفوق إجمالي حوادث عام 2024 بأكمله بنسبة 19%.

الاحتيال المالي: ارتفعت محاولات الاحتيال باستخدام التزييف الصوتي والهوية المزيفة بنسبة فلكية بلغت 1740% في أمريكا الشمالية.

الاستغلال اللاأخلاقي: تظل الإحصائية الأكثر إيلاماً هي أن ما بين 96% إلى 98% من محتوى التزييف العميق المتداول على الإنترنت هو محتوى إباحي غير تراضٍ (Non-consensual)، يستهدف النساء بشكل شبه حصري، مما يجعله أداة للابتزاز والتشهير الرقمي.

رابعاً: التحيز الخوارزمي والتمييز الآلي

الذكاء الاصطناعي ليس محايداً، بل يرث تحيزات صانعيه والبيانات التي تدرب عليها:

التحيز في التوظيف: أثبتت الدراسات أن خوارزميات التوظيف غالباً ما تستبعد السير الذاتية للنساء أو الأقليات العرقية بناءً على أنماط تاريخية متحيزة في البيانات.

الرعاية الصحية: وجدت أبحاث من MIT أن نماذج الذكاء الاصطناعي المستخدمة في التشخيص الطبي قد تكون أقل دقة عند التعامل مع الفئات الديموغرافية غير الممثلة بشكل جيد في بيانات التدريب، مما يؤدي إلى تفاوت في جودة الرعاية الصحية ونتائج العلاج.

نحو مستقبل رقمي مسؤول

إن استعراضنا لهذه المعطيات المقلقة لا يدعو بالضرورة إلى نبذ التكنولوجيا أو محاولة إيقاف عجلة التقدم، بل يفرض علينا واقعاً جديداً يتطلب يقظة غير مسبوقة. إن الفجوة الحالية بين سرعة تطور الذكاء الاصطناعي وقدرتنا التشريعية والأخلاقية على الاحتواء تمثل تهديداً حقيقياً يجب التعامل معه بجدية تامة قبل فوات الأوان.

المسؤولية اليوم مشتركة وتقع على عاتق المطورين، والشركات التقنية، والحكومات، والمؤسسات التعليمية، والمجتمع المدني بأسره. نحن بحاجة ماسة إلى ميثاق عالمي ملزم يضمن شفافية الخوارزميات، ويفرض ضوابط بيئية صارمة على مراكز البيانات، ويضع حداً لانتهاك الخصوصية والكرامة البشرية. إن الوعي بهذه الجوانب المظلمة هو الخطوة الأولى والأهم لضمان أن تظل هذه التكنولوجيا أداة للبناء والارتقاء بالإنسانية، وليست معولاً لهدم قيمنا ومجتمعاتنا.

كتب هذا المقال بالاستعانه بهذا التقرير:

Pindrop 2024 Voice Intelligence & Security Report

لا يسمح بنقل هذا المحتوى من سوالف دون الاشارة برابط مباشر